来源:临床与咨询心理实验室 侵删

原创:心理思辨 2022年5月5日

随着科技的发展,越来越多曾经人们无法想象的事情正在出现可能。

2019年《奇葩说》的一道辩题就把这样一个问题带到了大家的眼前。

“爱人离世,你会把TA的记忆交给AI吗?”同样的问题其实可以拓展到亲人身上,当我们的生命中出现无法回避的离别时,科技是否真的能够弥合人们遭受到的伤痛呢?

利用已逝亲人的声音和记忆制作出的陪伴程序,顾名思义,其本质上便是利用科学技术制作的虚拟的人工智能程序,它或许可以用亲人的声音说话,一问一答,甚至能模拟TA的性格、行为,但绝对和真人存在一定区别。

场上的交锋精彩纷呈,无论是“最是人间留不住,朱颜辞镜花辞树”的关于离别之凄美的描述,还是“记忆就是一个人活着的证据,就是他活在这个世间留下的痕迹”的论断,归根到底,AI恋人的意义无非是缓解在世之人无法直面死别的哀伤,那么哀伤究竟是如何产生和褪色的呢?

“AI亲人”的陪伴

通过AI技术制作出虚拟陪伴程序替代亲人,这一想法并不是天方夜谭。这一事件正在我们身旁悄悄发生。

2016年,美国记者James Vlahos的父亲查出肺癌晚期,悲痛的James冒出了一个疯狂的想法:利用AI技术将他与父亲的记忆永远保存!James成功说服了父亲和家人,在James的父亲在生前最后几个月,他向James讲述了自己的生平故事。同时,James自学代码,利用AI公司Pull String的开源软件进行开发。其中包括140多个相关的问题词条,并用多达9万个词的语料库训练AI。最终,在父亲离世前,他完成了一个为父亲量身定制的人工智能程序,当他和家人想父亲时,就打开这个程序聊几句,这给他和他的家人莫大安慰。

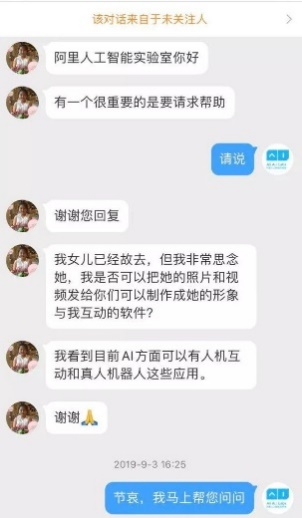

无独有偶,类似的事件同样也在中国发生。在2019年9月,阿里巴巴人工智能实验室接到了一个特殊的请求:一位失去女儿的母亲希望可以将孩子做成“AI”,用另一种方式缅怀女儿。

经过慎重考虑,阿里巴巴人工智能实验室答应了这位母亲的请求。经过长达3个月时间的努力,通过这位母亲提供的信息,阿里团队合成了一段女儿长达20秒的语音,交给了这位母亲。

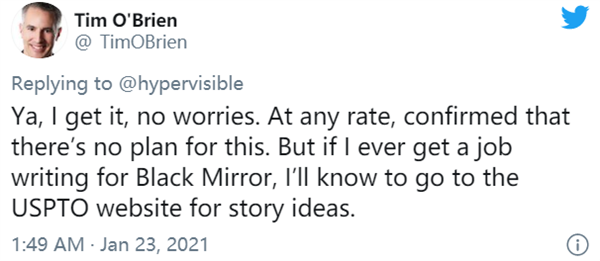

AI替代逝去真人不单单是个例,在未来可能会变成普遍现象。在2021年1月,Forbes报告称微软公司递交了专业申请,未来有可能以聊天机器人的形式实现逝者数字化重生。据网站Ubergizmo消息称,微软将通过特定个人的内容创造聊天机器人,该聊天机器人能模仿人的个性、说话方式,甚至可以创建3D真人模型。但是,微软AI程序负责人Brien也表示目前还没有任何明确计划可以将算法付诸实践。

将记忆交给AI的利与弊

“利用已逝亲人的声音和记忆制作出的AI陪伴程序,是否能够有效地疗愈哀伤者?”这的确是一个值得探讨的问题,在线上线下也激起了人们广泛地讨论。那么就让我们一起来看看其中的利弊观点吧。

◊ 利 处

01 AI工具的科技优势

承载着已逝亲人声音和记忆的AI陪伴程序作为纪念或回忆道具,可以有效帮助哀伤者。说到底,无论科技如何发达,无论技术怎样变幻,对于我们来说,其实AI陪伴程序只是一个存储的工具。比起传统的遗照、遗物等等纪念品,这个工具能够利用高科技的手段将离世亲人的音容笑貌更好地保留下来,让被留下的人得到慰藉。

02 对离世者的尊重

记忆,就是一个人活着的证据,是一个人活在这个世间留下的痕迹。利用已逝亲人的声音和记忆制作的AI陪伴程序,不仅仅可以疗愈哀伤者,还可以让离去的人被这个世界记住,就像一颗不曾熄灭的星星。

03 弗洛伊德理论的质疑

弗洛伊德从心理动力的角度,将哀伤反应解释为“力比多”无法收回。该理论认为只有切断与死者的联结才能治愈哀伤,这一点在近30年的研究中开始被质疑。研究者发现东方文化鼓励个体保留与死者的情感联结,而且正常的哀伤反应不是切断与死者的联结,而是在精神层面为死者找到一个归宿。后期有研究者提出了持续性联结的理论,并通过实证研究证实持续性联结并非完全是消极的,当生者可以放弃找寻与死者的实际联结,将联结的愿望转化为心理联结(例如保留死者的优秀品质),就可以得到满足并成功度过丧失危机 。

04 预防极端情况的发生

AI能在丧亲痛苦最严重的时期能给患者一个倾诉的渠道和维系与死者情感连结的手段,缓解哀伤最严重时期的症状,先防止不可逆的后果产生,如患者自杀或患上更严重的精神疾病,再说后续的康复。研究表明,丧亲后抑郁发作或焦虑障碍发生率增多,且丧亲者因心脏病、肝硬化、自杀、事故等原因导致的死亡率也明显增加 。假如患者身心状况并不乐观,存在较大的健康风险,那么AI的模拟陪伴不失为一种缓解症状的方法。好的治疗方法应多管齐下、标本兼治。

05 专业人员的指导

咨询师可以指导患者,在使用AI时能接受亲人的死亡,避免对其过度依赖,作为建立心理连结、满足心理需要的一种方式,提高患者的生活质量。而且,正常的哀伤反应也不是切断与死者的联结,因此,AI维持联结的功能本身或不构成对患者恢复过程的阻碍;最重要的应是防止误用。

◊ 弊 端

01 社会伦理道德问题

将死者AI化是否存在伦理问题和法律风险?就算是亲属,有权利动用死者的记忆么,死者在这方面拥有隐私权么?如果真的作出了贴近死者的AI陪伴程序,其所属权如何定义,是归属亲属还是制作公司?死者的记忆数据是否会出现泄露问题,其数据安全性值得担忧……这些科技与人伦的碰撞擦出的矛盾,都值得我们更谨慎地考虑这项技术的可行性。

02 科技可行性

虽然单从技术角度考虑,在足够的语料数据和算法的加持下,通过目前的语音合成技术,“复制”一个虚拟人的难度并不大。但是目前的科技真的能有效地还原出离世之人生前的言行举止么?这一点在阿里巴巴帮助失独妈妈制作出女儿AI的真实案例中得以体现:一方面,由于语料的缺失与模糊,对话训练难度变得极大,凭借现有的技术很难达到妈妈心中理想的对话效果,而这也就意味着,无论技术团队如何攻坚,AI终究不是“真实”的女儿。更不用说,除了语音合成,技术团队也坦诚地表达了对“AI女儿”认知上的担忧。当妈妈问出一个问题,“AI女儿”是否能够以女儿的认知水平和价值观来回答,在这方面的技术问题目前还较难攻克。

03 疗愈有效性

这种疗愈手段不能有效地减轻创伤者的痛苦,反而会让发展过程停滞。就像二宝的来临不能治愈失独再生养家庭的伤痛,丧子的伤疤还在那里,不断地撕扯着、叫嚣着,不会因为二宝的出生就愈合消失。同样的,虚拟的AI不能掩盖丧亲的痛苦。丧亲后转向一个模拟亲人的虚拟程序的做法其实是在试图用外在的物质重新唤起与逝者之间的联结、制造出种种TA仍存在的假象。然而心理学研究表明,旧的联结其实是在回避或压抑亲人逝世的伤痛。而经验性的回避不仅会维持痛苦的感受,还会让他因此失去真正能够纾解哀伤的通道—建立真正有益的持续性联结。瑞士精神科医生将死亡创伤带来的悲哀分为否认、愤怒、谈判、绝望、接受五步。有了AI陪伴的创伤者被人为地打断了脱离创伤的过程,他们更可能被虚假的陪伴欺骗,呈现出一种表面的风平浪静,事实却是他们的哀伤发展停滞在拒绝、否认的阶段。综上所述,利用亲人的声音记忆制作AI程序既存在伦理问题,又无法减轻创伤者情感上的痛苦、不能满足情感上的需求,所以可能这不是一种好的疗愈手段。

04 科技问题造成的意外伤害

由于现在复杂的网络环境和日新月异的科技,很多事情并不在制作者或是心理医生的预料之内。市面现有的语音助手,例如Siri和天猫精灵,当输入的语言超过AI的理解范围时,它的设定是去网络检索一个最接近的回答进行反馈,这就存在很大的不可控性。比如上个月,亚马逊的语音目助手Alexa就因为从维基百科中提取到了一些恶意文本,劝主人“自杀”,对英国一位29岁的医生丹妮说出了“用尖刀刺入心脏”这样可怕的话。所以我们不能排除这种意外给本就在悲痛之中的用户带来沉重一击,从而导致一些不可挽回的结果的可能性。

05 经验性回避

患者与AI相处的过程中可能沉浸在亲人没有死去的假象之中,回避亲人死去的事实,由此产生经验性的回避。研究表明,经验性的回避将会维持痛苦的感受,而且也会阻碍人们充分地去活在当下,更无法对将来的生活充满信心和希望 。这是不利于患者真正康复的。

将去世亲人的记忆与声音存入AI来疗愈哀伤者,这是一把双刃剑。诚然,科技能够在一定程度上弥补亲人去世后的伤痛,但从长远来看,AI程序的效果是未知的。此外,从人性伦理及当下科技的限制角度去看,此方法也会受到重重阻碍。但是,仅凭单方面的好处或隐患,就对一种新方法全盘接纳或严格限制,都是不理智的行为。如今,AI陪伴程序刚刚迈出第一步,相信在未来的不懈探索与努力之下,将高科技手段与心理学理论完美契合,哀伤者的疗愈手段会发生伟大的革新。那时,在面对亲人离世时,人们也可以坦然接受,顺利度过哀伤的各个阶段。