来源:新华网 2024-02-26 侵删

近年来,随着人工智能技术的进步,一些不法分子开始利用AI技术融合他人面孔和声音,制造非常逼真的合成图像来实施新型网络诈骗,这类骗局常常会在短时间内给被害人造成较大损失。我们应该如何看清这类AI“深度造假”?辨别“AI换脸”有没有什么好方法?我们先来看看近期发生在陕西西安的一起“AI换脸”诈骗案例。

陕西西安财务人员张女士与老板视频通话,老板要求她转账186万元到一个指定账号。

被害人 张女士:老板让把这个款赶紧转过去,这个款非常着急,因为他声音还有视频图像都跟他人长得一样的,所以就更确信这笔款是他说的了,然后我直接就把这笔款转了。

转账之后,张女士按照规定将电子凭证发到了公司财务内部群里,然而出乎意料的是,群里的老板看到信息后,向她询问这笔资金的来由?

被害人 张女士:然后我们就打电话再跟老板去核实,老板说他没有给我发过视频,然后也没有说过这笔转账。

意识到被骗的张女士连忙报警求助,警方立刻对接反诈中心、联系相关银行进行紧急止付,最终保住了大部分被骗资金156万元。

AI“多人换脸”诈骗案 骗走2亿港元

一百多万的现金,对大部分人来说都算是一笔巨款了,好在警方处理及时,挽回了大部分损失,下面我们再来看另一起案例,这起案例的“换脸”技术难度更高,涉案金额也更大。近期, 香港警方也披露了一起AI”多人换脸”诈骗案,涉案金额高达2亿港元。

在该起案件中,一家跨国公司香港分部的职员,受邀参加总部首席财务官发起的多人的视频会议。并按照要求,前后转账多次,将2亿港元转账到5个本地银行账户内,其后向总部查询方知受骗。警方调查得知,这起案件中,所谓的视频会议中,只受害者一人为“真人”,其余所谓参会人员,全部是经过AI换脸后的诈骗人员。

看完这两起案例,您一定有些好奇,AI换脸背后的技术原理到底是什么?在技术层面,它是如何实现人脸的精确识别与替换,创造出逼真效果?我们来听听专家的讲解。

技术上如何实现人脸精确识别与替换

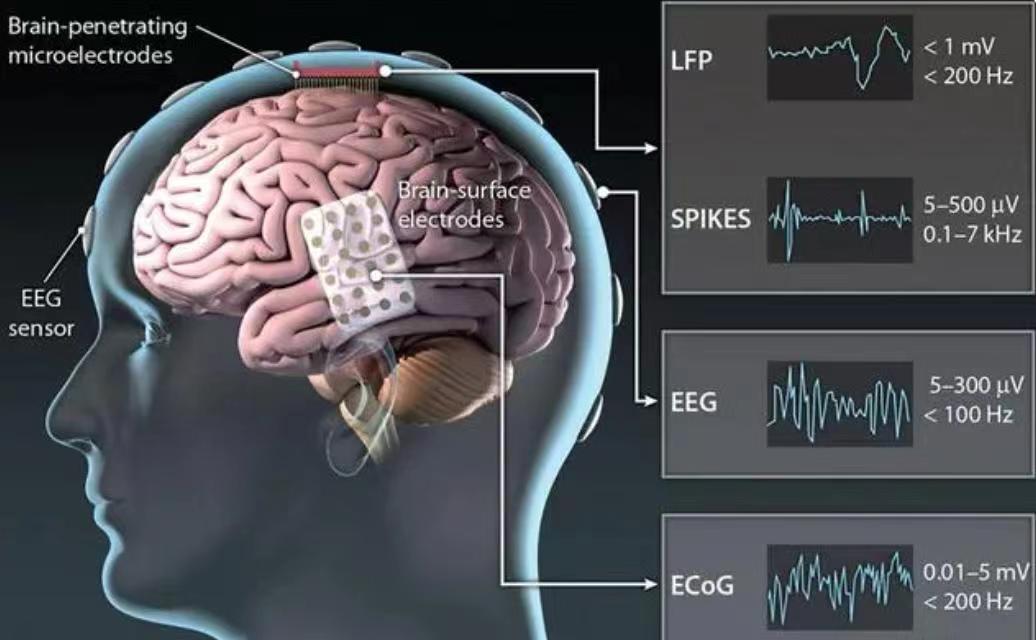

中国网络空间安全协会人工智能安全治理专委会专家 薛智慧:AI换脸过程主要包括人脸识别追踪、面部特征提取、人脸变换融合、背景环境渲染、图像与音频合成等几个关键步骤。其背后最核心的包括为三个部分,首先,利用深度学习算法精准地识别视频中的人脸图像,并提取出如眼睛、鼻子、嘴巴等关键面部特征。其次,将这些特征与目标人脸图像进行匹配、替换、融合。最后,通过背景环境渲染并添加合成后的声音,生成逼真度较高的虚假换脸视频。

快速AI“换脸”仅通过一张照片就可完成

为了了解AI换脸到底能有多么逼真,记者经过与专业技术人员合作,深度体验了AI换脸技术。

技术人员首先用手机给记者拍了一张脸部照片,导入到AI人工智能软件后,让记者惊讶的是,虽然电脑摄像头前的是技术人员,但是输出的确是记者的照片,几乎可以说是“一键换脸”,不需要复杂的环境和解压操作。

更令人惊讶的是,随着技术人员面部表情变化,照片上记者的脸也跟着一起发生了相应变化。

记者:为什么技术人员这张脸动,我的照片会跟着动呢?

中国网络空间安全协会人工智能安全治理专委会专家 薛智慧:首先通过视频的采集,能够把图片里这个人脸的面部追踪定位到,定位到以后第二步他能够做一个人脸的面部特征点的采集和提取,主要就是包括嘴、鼻子跟眼睛相关的这些明显的面部特征。采集到以后, 第三步就跟把这张原始的照片,做一个变换跟融合跟整形。

记者:通过这张照片还可以做到什么?

中国网络空间安全协会人工智能安全治理专委会专家 薛智慧:当前通过这张照片技术人员已经让这张照片能够动起来,活起来了,而如果更进一步的将这张照片存下来,能够存储大量的照片的话。后期可以把这张照片合成一段简短的视频发布出来。

人工智能人脸检测技术主要通过深度学习算法实现,这种技术能够识别出面部特征并对其进行精准的分析。可以将一个人的面部表情从一张照片或视频中提取出来,并将其与另一个人的面部特征进行匹配。专家告诉记者,如果想要实现视频实时通话时采用人工智能AI换脸技术,一张照片是远远不够的,那就需要不同角度的近千张照片的采集。

中国网络空间安全协会人工智能安全治理专委会专家 薛智慧:如果要实时点对点交流的话,需要再采集更多的照片,完了进行深度学习算法模型的训练,训练出来这个模型以后灌到咱们这个视频里去,就可以做实时的变化跟转换了。这种情况下,就可以做到实时的变脸。声音的交流也可以,需要预先采集一些咱们目标人群当中的声音,然后进行模型的训练,能够把目标人群的声音还原出来。

AI生成仿真度极高视频 难度高投入大

专家介绍,以诈骗为目的,实施点对点视频通话,需要AI人工智能生成仿真度极高的视频。想要达到以假乱真效果用于诈骗,难度不小。

中国计算机学会安全专业委员会数字经济与安全工作组成员 方宇:针对诈骗,其实主要是通过点对点的视频通话,这时候如果采用换脸技术和声音合成做实时的换脸诈骗的话,想要完成这些技术操作,就需要投入很强的技术支持。

中国网络空间安全协会人工智能安全治理专委会专家 薛智慧:背后需要有大量的资金的投入,包括图片的采集,包括专业算法的人员等等,需要很长的一个周期,包括一些算力算法。各方面的投入,需要长时间不断地迭代,进行操作,才能达到一个相当逼真的效果,才有可能实现到诈骗的实际效果。

目前AI“换脸”更多应用于娱乐视频录制

除了一些不法分子企图利用AI技术实施诈骗,事实上,近年来,AI技术更多地被应用于短视频的二次创作,属于娱乐性质,越来越多的名人AI换脸视频出现在网络上,不少网友感叹,这类视频“嘴型、手势都对得上,太自然了,差点儿以为是真的。”

比如这款软件,拍下记者面部照片后,就能录制生成出一段记者秒变赛车手的视频。

△网友发布的女士系丝巾原版视频

△网友发布的女士系丝巾原版视频

△需要变换的脸的照片

△需要变换的脸的照片

△生成视频

△生成视频

中国计算机学会安全专业委员会数字经济与安全工作组成员 方宇:AI技术目前我们常看到的主要是短视频换脸,通过做一些特定的动作,跳舞啊等等。这些视频其实看起来是有一些不自然的,本身也是纯属于娱乐性质的换脸。

记者发现在手机应用商城中,有数十款换脸软件,都可以做到换脸的目的。

中国网络空间安全协会人工智能安全治理专委会专家 薛智慧:如果从娱乐大众的角度来说的话,现在市面上也有很多的这些软件和工具,能够达到AI换脸的效果,但是仿真度只有六七分的样子,大众直接就能看出来。但是如果要生成一个诈骗视频来说话,就要生成咱们仿真度极高的这种点对点视频。

AI技术“换脸换声”可能存在法律风险

不过,AI技术也是把“双刃剑”,即使是出于娱乐使用AI换脸、AI换声,也是存在法律风险的。法律专家表示,用AI技术为他人换脸换声甚至翻译成其他语言并发布视频,可能涉嫌侵权,主要有三个方面:

一是涉嫌侵犯著作权,例如相声、小品等都属于《中华人民共和国著作权法》保护的“作品”。例如网友用AI软件将相声、小品等“翻译”成其他语言,需经过著作权人授权,否则就存在侵权问题。

二是涉嫌侵犯肖像权,根据《中华人民共和国民法典》,任何组织或者个人不得以丑化、污损,或者利用信息技术手段伪造等方式侵害他人的肖像权。未经肖像权人同意,不得制作、使用、公开肖像权人的肖像,但是法律另有规定的除外。

三是涉嫌侵犯声音权,根据《中华人民共和国民法典》规定,对自然人声音的保护,参照适用肖像权保护的有关规定。也就是说,需要取得声音权人的同意,才能够使用他人的声音。

学会几招 轻易识别AI“换脸换声”

AI换脸这一技术的出现,导致耳听为虚、眼见也不一定为实了。那我们该如何防范呢?专家表示,其实AI人工换脸无论做得多么逼真, 想要识别视频真假还是有一些方法的。

中国计算机学会安全专业委员会数字经济与安全工作组成员 方宇:实际上从我目前看到的深度伪造的实时视频上来看,其实还是可以通过一些方式,去进行一些验证。

那比如说我们可以要求对方在视频对话的时候呢,在脸部的面前通过挥手的方式,去进行一个识别,实时伪造的视频,因为它要对这个视频进行实时的生成和处理和AI的换脸。

那么在挥手的过程中,就会造成这种面部的数据的干扰,最终产生的效果就是我们看到的这样,挥手的过程中,他所伪造的这个人脸会产生一定的抖动或者是一些闪现,或者是一些异常的情况。

第二个就是点对点的沟通中可以问一些只有对方知道的问题,验证对方的真实性。

提高防范意识 避免个人生物信息泄露

专家表示,除了一些辨别AI换脸诈骗的小诀窍,我们每一个人都应该提高防范意识,在日常生活中也要做好相关防范措施,养成良好的上网习惯。首先应该是做好日常的信息安全的保护,加强对人脸、声纹、指纹等生物特征数据的安全防护:另外做好个人的手机、电脑等终端设备的软硬件的安全管理。第二,不要登录来路不明的网站,以免被病毒侵入。第三,对可能进行声音、图像甚至视频和定位采集的应用,做好授权管理。不给他人收集自己信息的机会,也能在一定程度上让AI换脸诈骗远离自己。

伴随AI技术发展 需要多层面监管规范

除了要提高自我防范意识,如何对AI技术加强监管,也成了越来越多人关注的问题。AI技术本身不是问题,关键是我们要怎么用它?如何形成有效监管?专家介绍,AI技术发展,需要多层面监管规范。

一是在源头端,需要进一步加强公民个人信息保护,尤其是加强对生物特征等隐私信息的技术、司法保护力度。二是在技术层面可以加强管理。例如可以让视频传播网站或者社交软件,使用专业的鉴别软件来鉴定,对AI生成视频,打上不可消除的“AI生成”水印字样。目前,这种数字水印鉴伪技术有待进一步普及。三是在法律制度层面,要进一步完善人工智能等领域相关法律法规。2023年8月15日,我国正式施行《生成式人工智能服务管理暂行办法》。《办法》从多个方面“划下红线”,旨在促进生成式人工智能健康发展和规范应用。 (记者 崔世杰)

△网友发布的女士系丝巾原版视频

△网友发布的女士系丝巾原版视频 △需要变换的脸的照片

△需要变换的脸的照片 △生成视频

△生成视频

从人工智能的应用方式来看,人工智能以前所未有的方式展现其强大的信息处理能力,其本质是提升人类对信息的利用效率和效果。而人类社会有其基于特定国家和文化的法律法规和道德约束,人工智能发展也要充分遵从法律法规和道德伦理。

从人工智能的应用方式来看,人工智能以前所未有的方式展现其强大的信息处理能力,其本质是提升人类对信息的利用效率和效果。而人类社会有其基于特定国家和文化的法律法规和道德约束,人工智能发展也要充分遵从法律法规和道德伦理。

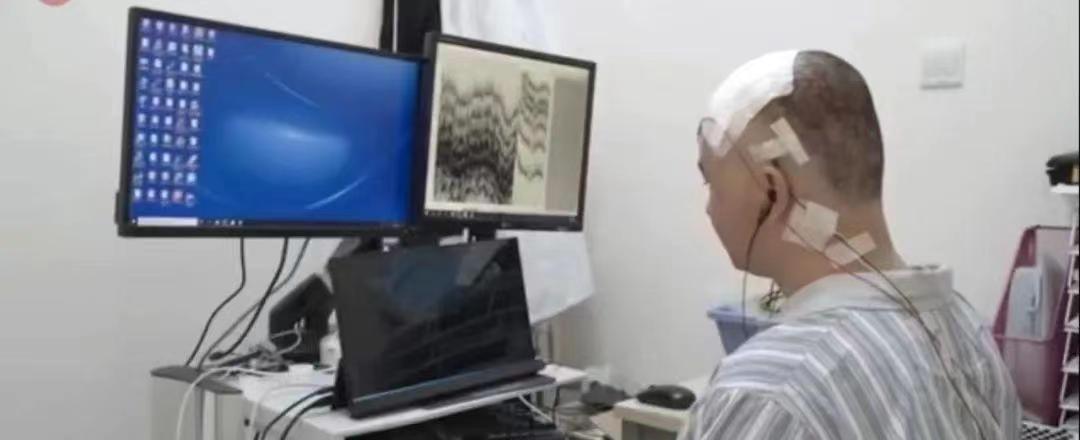

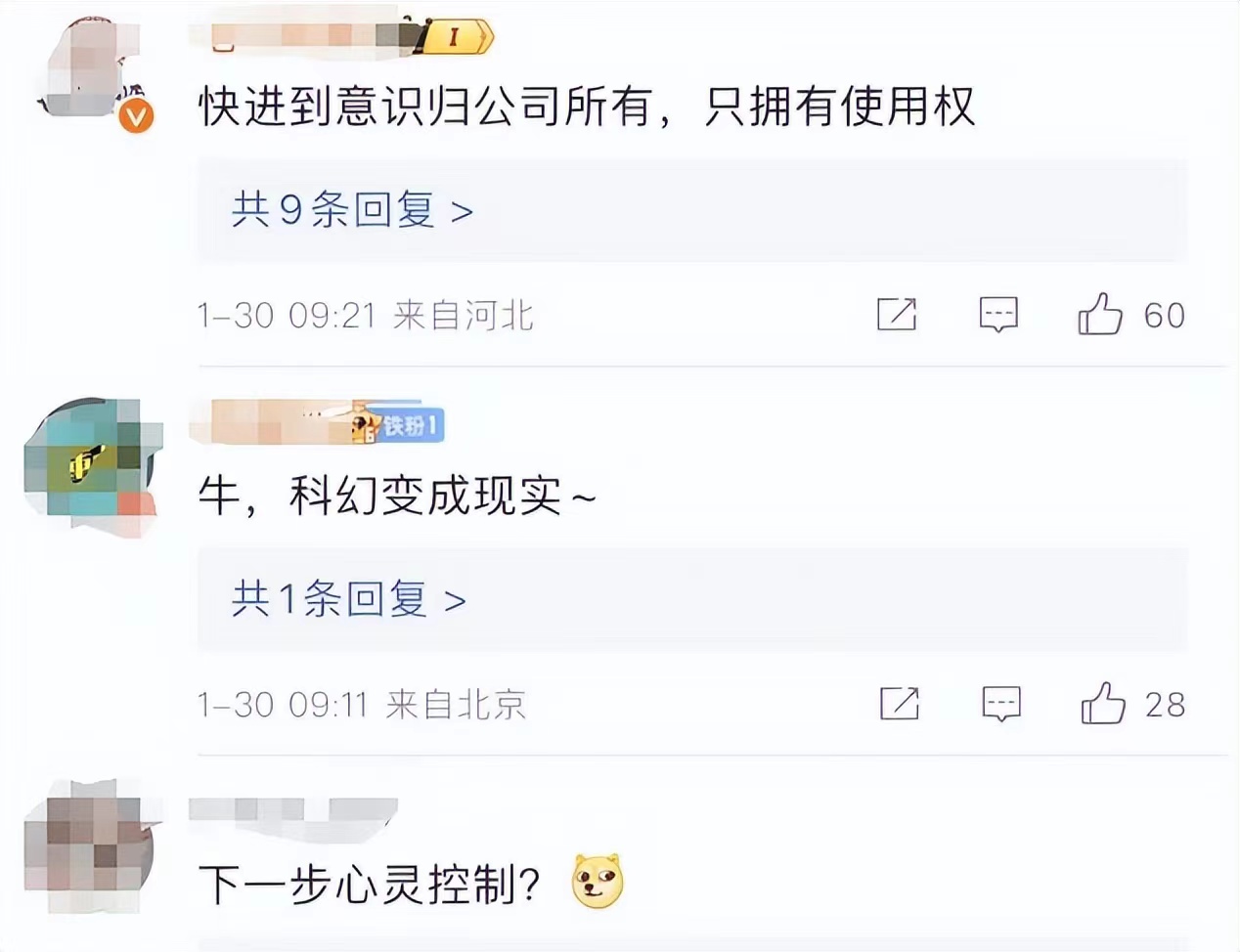

1 月 30 日,他在个人社交平台上高调宣布,旗下的脑机接口公司已完成首例人类大脑设备植入手术,目前志愿者恢复良好。

1 月 30 日,他在个人社交平台上高调宣布,旗下的脑机接口公司已完成首例人类大脑设备植入手术,目前志愿者恢复良好。